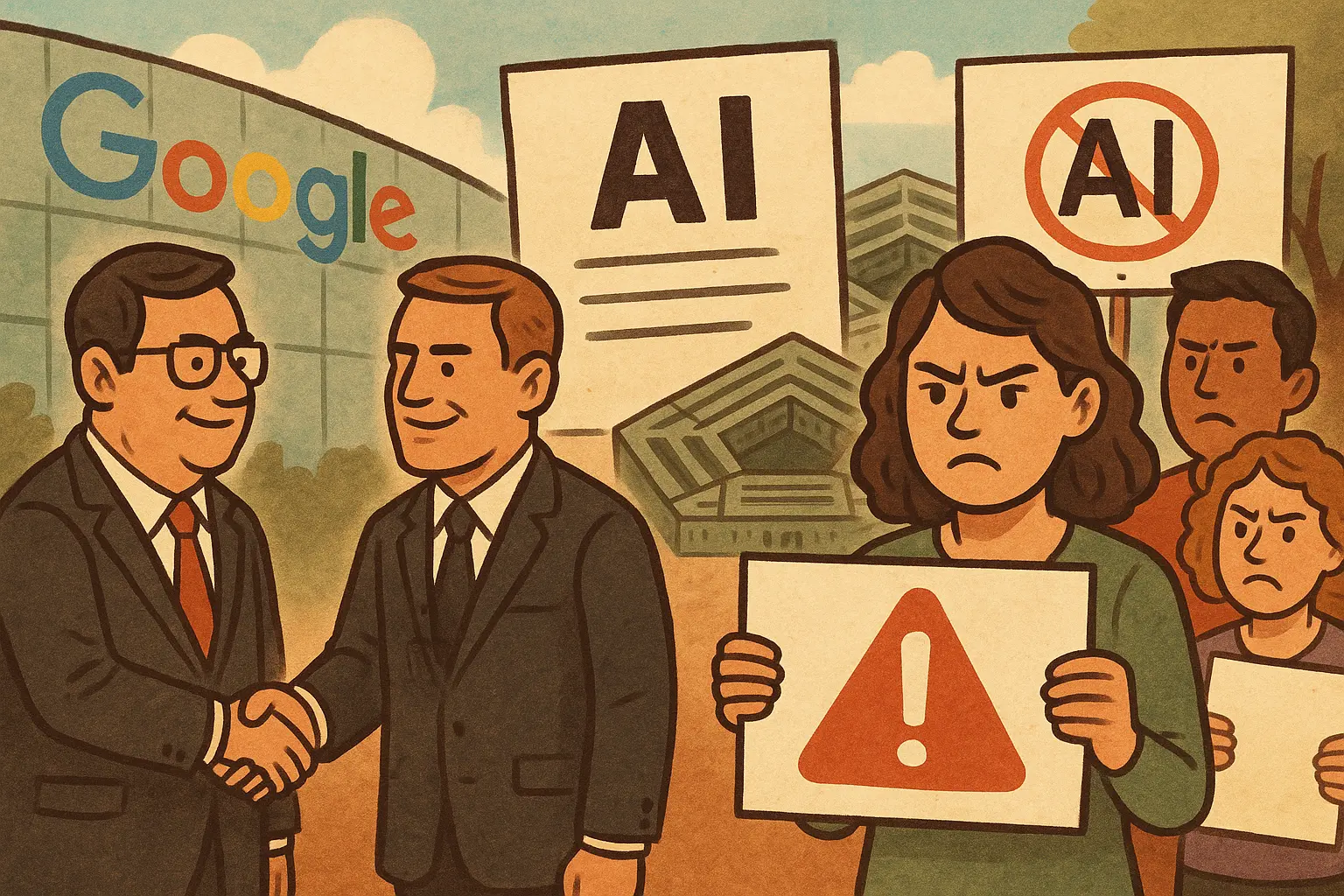

Google e o Pentágono assinam acordo secreto de IA, carta aberta de funcionários se opõe

De acordo com a The Information, em 28 de abril, o Google assinou um acordo para fornecer ao Pentágono modelos de inteligência artificial (IA) para trabalhos confidenciais. O The New York Times, citando pessoas com conhecimento do assunto, disse que o acordo permite ao Departamento de Defesa usar a IA do Google para fins governamentais legais, com natureza semelhante aos acordos confidenciais de implantação de IA que o Pentágono assinou mês passado com a OpenAI e a xAI.

Conteúdo do acordo e contexto de múltiplas partes

De acordo com a reportagem do The New York Times citando pessoas com conhecimento do assunto, o acordo entre o Google e o Pentágono permite que o DoD use os modelos de IA do Google em trabalhos confidenciais. O Pentágono já havia concluído assinaturas semelhantes separadamente com a OpenAI e a xAI no mês passado, permitindo a implantação de modelos de IA em redes confidenciais; o acordo do Google é o exemplo mais recente de uma ampliação da cooperação em IA pelo Pentágono.

Em comunicado ao The New York Times, um porta-voz do Google disse: “É uma honra fazer parte de uma ampla coalizão formada por laboratórios de IA líderes, empresas de tecnologia e de nuvem, para fornecer serviços de IA e infraestrutura para a segurança nacional.” A Decrypt entrou em contato com o Google para comentar sobre o assunto e, até o momento em que a reportagem foi publicada, o Google ainda não havia respondido.

Carta aberta de funcionários: instando a recusar cargas de trabalho confidenciais

De acordo com a reportagem do The New York Times, antes da assinatura do acordo, centenas de funcionários do Google já haviam assinado uma carta aberta, endereçada ao CEO Sundar Pichai, instando a empresa a não fornecer sistemas de IA ao Pentágono para trabalhos confidenciais.

A carta aberta escreveu: “Esperamos que a IA faça bem à humanidade, e não seja usada para fins desumanos ou extremamente prejudiciais. Atualmente, a única forma de garantir que o Google não tenha qualquer relação com esse tipo de dano é recusar qualquer carga de trabalho confidencial. Caso contrário, tais usos podem acontecer sem que saibamos ou sem que consigamos impedir.”

Na carta, “armas autônomas letais e vigilância em larga escala” são listadas como as principais preocupações, e ela alerta que “tomar a decisão errada agora causará danos irreparáveis à reputação, aos negócios e à posição do Google no mundo”.

Processo de integração de IA no Pentágono e caso da Anthropic

De acordo com a reportagem do The New York Times, o secretário de Defesa dos Estados Unidos, Pete Hegseth, em janeiro deste ano, em um discurso na Starbase de Elon Musk, disse: “A América precisa vencer a competição estratégica pela supremacia tecnológica no século XXI” e afirmou que “cada uma das nossas redes não confidenciais e confidenciais do nosso departamento implantará em breve modelos de IA líderes no mundo”. Desde então, o Pentágono acelerou os passos para fechar acordos com as principais empresas de IA.

Quanto ao contexto relacionado, de acordo com reportagens relacionadas, em março deste ano o Pentágono classificou a Anthropic como uma empresa de “risco de cadeia de suprimentos”, em razão de o CEO da Anthropic, Dario Amodei, ter se recusado a permitir que o governo federal use seus modelos de IA sem restrições; posteriormente, a Anthropic processou o Pentágono com base na referida determinação e buscou continuar a cooperar com outros departamentos do governo.

Perguntas frequentes

Que usos o acordo confidencial de IA do Google com o Pentágono permite?

De acordo com reportagem do The New York Times citando pessoas com conhecimento do assunto, o acordo permite ao DoD usar a IA do Google para “qualquer finalidade governamental legal”. Um porta-voz do Google disse que a empresa mantém a posição de que a IA não deve ser usada para vigilância doméstica em larga escala ou armas autônomas sem supervisão humana.

Com quais empresas de IA o Pentágono já assinou acordos semelhantes?

De acordo com a reportagem do The New York Times, no mês passado o Pentágono assinou acordos, respectivamente, com a OpenAI e a xAI, permitindo a implantação de IA em redes confidenciais; o acordo do Google é o exemplo mais recente desse tipo de cooperação.

Qual é a posição da Anthropic sobre questões semelhantes?

De acordo com reportagens relacionadas, em março deste ano o Pentágono classificou a Anthropic como uma empresa de “risco de cadeia de suprimentos”, em razão de a Anthropic recusar permitir que o governo federal use seus modelos de IA sem restrições; posteriormente, a Anthropic processou o Pentágono com base na referida determinação e buscou continuar a cooperar com outros departamentos do governo.

Related Articles

Audiência no tribunal de OpenAI: Brockman depõe; Musk já teria dito que não vai fazer segurança e que as negociações de ações podem ficar violentas

Empresas indianas de cibersegurança usam IA para reduzir testes de vulnerabilidades para horas

Desmascarando a bolha da IA! CEO da BlackRock: a escassez de poder de computação vai dar origem a um “mercado de futuros de computação”

O CEO da Tether Anuncia uma Prova de Pesquisa em IA que Deve Chegar Esta Semana

A Anthropic lança 10 agentes de IA financeiros, integrados ao Microsoft 365 para lidar facilmente com tarefas de finanças