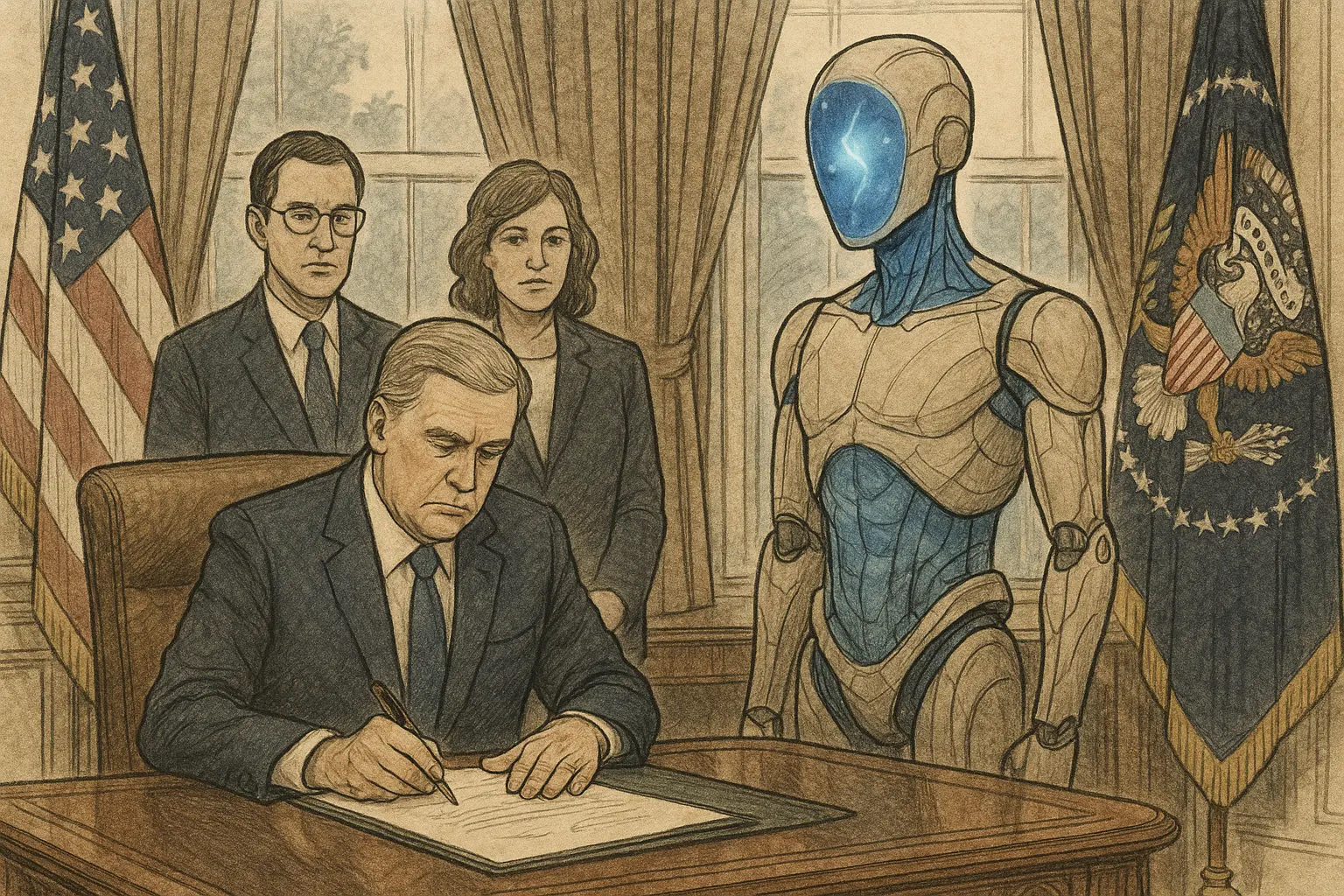

Mídia norte-americana: um projecto de ordem executiva da Casa Branca permite a entrada do modelo Anthropic Mythos no governo

De acordo com uma notícia citada a 28 de Abril pela Axios e atribuída a fontes com conhecimento do assunto, a Casa Branca está a preparar orientações que permitiriam a todos os organismos federais contornar a avaliação de risco da cadeia de fornecimento (SCRD) da Anthropic e introduzir novos modelos, incluindo o modelo Mythos da Anthropic, para utilização por parte do Governo. A propósito disso, a Casa Branca publicou uma declaração oficial afirmando que quaisquer declarações de políticas serão emitidas directamente pelo Presidente, e que qualquer outra versão dos factos é apenas especulação.

Contacto recente da Casa Branca e medidas propostas

Segundo a Axios, numa notícia de 28 de Abril, no início deste mês a Chefe de Gabinete da Casa Branca, Susie Wiles, e a Ministra das Finanças, Scott Bessent, reuniram-se conjuntamente com o CEO da Anthropic, Dario Amodei; ambos descreveram a reunião como uma sessão introdutória produtiva, em que foi discutida a direcção da cooperação da empresa com o Governo.

Ainda esta semana, a Casa Branca convocou empresas de vários sectores para recolher informação sobre possíveis medidas administrativas e melhores práticas para a implementação do sistema Mythos. De acordo com a Axios, as reuniões pertinentes incluíram “leituras de argumento” (table reads) às orientações propostas; as orientações em causa poderão contrariar instruções anteriores da OMB (Gabinete de Gestão e Orçamento) de que os departamentos do Governo não devem utilizar sistemas da Anthropic. A Anthropic recusou comentar as referidas notícias da Axios.

Contexto do litígio: avaliação de risco da cadeia de fornecimento e acção judicial no Pentágono

De acordo com a Axios, numa notícia de 28 de Abril, o Departamento de Defesa (DoD) tinha anteriormente publicado avaliações de risco da cadeia de fornecimento relativas à Anthropic e intentado acções judiciais no tribunal. O cerne do litígio reside no facto de a Anthropic se recusar a assinar um acordo que permitiria ao Pentágono utilizar o modelo Claude sob o critério de “todas as utilizações legais” (incluindo aplicações para drones); as cláusulas de proibição explícitas da Anthropic incluem vigilância interna em grande escala e o desenvolvimento de armas totalmente autónomas. O Pentágono respondeu que a recusa da Anthropic demonstra que não é um parceiro de confiança.

Segundo a Axios, apesar de o litígio legal estar em curso, os organismos do Governo, incluindo o Pentágono, ainda conseguem utilizar alguns modelos da Anthropic. O serviço de informações de segurança nacional dos EUA (NSA) também está a utilizar o Mythos. No entanto, o Pentágono continua a utilizar os termos de serviço antigos que ambos consideram demasiado restritivos e não consegue obter a versão mais recente de actualizações dos modelos da Anthropic.

Posição central da Anthropic e comparação com congéneres

De acordo com a Axios, numa notícia de 28 de Abril, a Anthropic insiste em recusar assinar um acordo de “todas as utilizações legais”, proibindo de forma clara utilizações que incluem vigilância interna em grande escala e o desenvolvimento de armas totalmente autónomas.

A Axios acrescenta ainda que a OpenAI e a Google já assinaram acordos com o Pentágono para permitir a utilização dos seus modelos, no critério de “todas as utilizações legais”, em ambientes confidenciais; ambas as empresas afirmam que os acordos respeitam as duas cláusulas de proibição definidas pela Anthropic.

Perguntas frequentes

Quais são os detalhes específicos das orientações relacionadas com a Anthropic que a Casa Branca pretende preparar?

De acordo com a Axios, numa notícia de 28 de Abril citando fontes com conhecimento do assunto, a Casa Branca está a preparar orientações que permitiriam aos organismos federais contornar a avaliação de risco da cadeia de fornecimento da Anthropic; as medidas poderão ser divulgadas sob a forma de ordem executiva e abranger instruções para a implementação do modelo Mythos. A declaração oficial da Casa Branca afirma que quaisquer declarações de políticas serão emitidas directamente pelo Presidente.

Qual é a causa fundamental do litígio entre o Pentágono e a Anthropic?

De acordo com a Axios, numa notícia de 28 de Abril, o litígio tem origem no facto de a Anthropic se recusar a assinar um acordo que permitiria ao Pentágono utilizar o modelo Claude sob o critério de “todas as utilizações legais”, com utilizações explicitamente proibidas que incluem vigilância interna em grande escala e o desenvolvimento de armas totalmente autónomas; posteriormente, o Pentágono publicou avaliações de risco da cadeia de fornecimento e intentou acções judiciais.

Qual é a posição da OpenAI e da Google neste mesmo tema?

De acordo com a Axios, numa notícia de 28 de Abril, tanto a OpenAI como a Google já assinaram acordos com o Pentágono para permitir a utilização dos seus modelos, no critério de “todas as utilizações legais”, em ambientes confidenciais, e ambas as empresas afirmam que os acordos respeitam as duas cláusulas de proibição definidas pela Anthropic.

Related News

A CFTC processa o Wisconsin, ação judicial em um único mês: 5 estados defendem a previsão de jurisdição do mercado

A incerteza na transição de poder na Reserva Federal: divergências na política da Waller aumentam, análise dos riscos de independência e do caminho da demonstração de resultados

A Google assinou um contrato de IA confidencial com o Pentágono, e centenas de funcionários subscreveram uma petição para se oporem — sem efeito.

Relatório diário Gate (28 de abril): A Casa Branca sugere que a reserva estratégica de Bitcoin tem uma “anúncio importante”; Israel aprova stablecoins indexadas a shekel

Agente do Cursor AI falhou! Uma linha de código apagou a base de dados da empresa em 9 segundos, a salvaguarda de segurança tornou-se conversa vazia