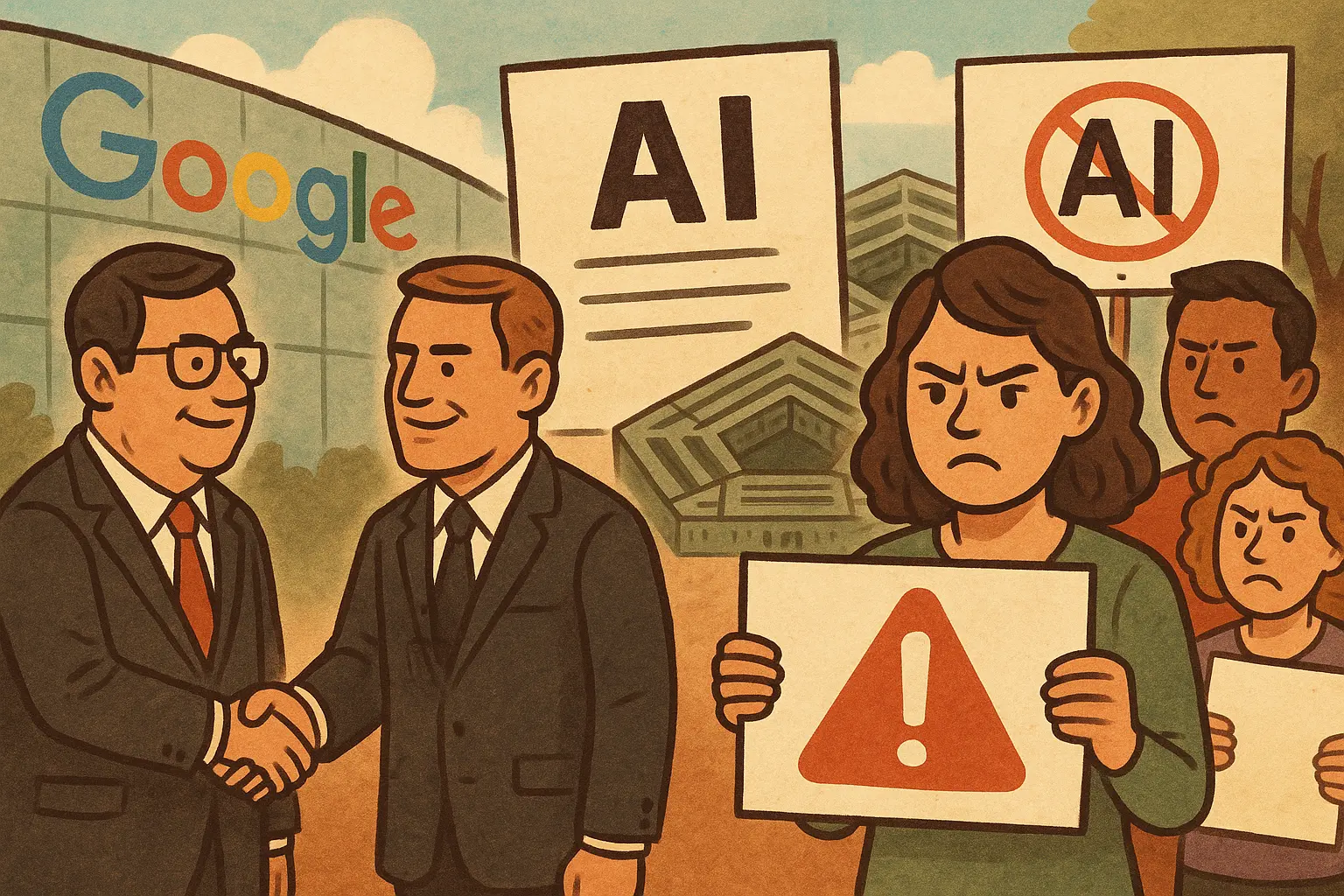

A Google assinou um acordo secreto de IA com o Pentágono, carta aberta dos funcionários contra

De acordo com o The Information, a 28 de abril, a Google assinou um acordo para fornecer ao Pentágono modelos de inteligência artificial (IA) destinados a tarefas confidenciais. O New York Times, citando fontes com conhecimento do assunto, afirma que o acordo permite ao Departamento de Defesa dos EUA usar a IA da Google para fins governamentais legais, com características semelhantes ao acordo de implementação de IA confidencial que o Pentágono assinou no mês passado com a OpenAI e a xAI.

Conteúdo do acordo e contexto de múltiplas partes

Segundo o relatório do New York Times citando fontes com conhecimento do assunto, o acordo entre a Google e o Pentágono permite ao DoD utilizar os modelos de IA da Google em trabalho confidencial. O Pentágono já tinha concluído, no mês passado, assinaturas semelhantes com a OpenAI e a xAI, permitindo a implementação de modelos de IA em redes confidenciais; o acordo da Google é o caso mais recente de expansão da cooperação em IA do Pentágono.

Em declarações ao New York Times, um porta-voz da Google disse: «Temos o prazer de fazer parte de uma aliança alargada composta por laboratórios de IA de referência, empresas tecnológicas e de cloud, para prestar serviços e infraestruturas de IA à segurança nacional». A Decrypt contactou a Google para comentar, até à data de publicação do relatório a Google ainda não tinha respondido.

Carta aberta dos colaboradores: apelo para recusar cargas de trabalho confidenciais

De acordo com o relatório do New York Times, antes de a assinatura do acordo ter ocorrido, centenas de colaboradores da Google já tinham subscrito uma carta aberta, dirigida ao CEO Sundar Pichai, instando a empresa a não fornecer ao Pentágono sistemas de IA para tarefas confidenciais.

A carta aberta escreveu: «Queremos que a IA beneficie a humanidade, e não que seja usada para fins desumanos ou extremamente prejudiciais. Atualmente, a única forma de garantir que a Google não tenha qualquer ligação a este tipo de danos é recusar qualquer carga de trabalho confidencial. Caso contrário, este tipo de utilização poderá acontecer sem o nosso conhecimento ou sem que possamos impedir.»

A carta enumera ainda «armas autónomas fatais e vigilância em grande escala» como principais preocupações, alertando que «tomar agora uma decisão errada causará um dano irreparável à reputação, aos negócios e à posição do mundo da Google».

Processo de integração de IA do Pentágono e caso da Anthropic

De acordo com o relatório do New York Times, o secretário da Defesa dos EUA, Pete Hegseth, disse, durante uma intervenção em janeiro deste ano na Starbase de Elon Musk, que: «Os EUA precisam de vencer a competição estratégica pela supremacia tecnológica do século XXI», e acrescentou: «Cada uma das nossas redes não confidenciais e confidenciais do nosso departamento irá, em breve, implementar modelos de IA de nível mundial.» A partir daí, o Pentágono acelerou o ritmo para chegar a acordos com as principais empresas de IA.

No que toca ao contexto relacionado, segundo relatórios pertinentes, em março deste ano o Pentágono classificou a Anthropic como uma empresa de «risco na cadeia de abastecimento», devido a o CEO da Anthropic, Dario Amodei, ter recusado permitir ao governo federal o uso ilimitado dos seus modelos de IA; posteriormente, a Anthropic processou o Pentágono com base nessa determinação e procurou continuar a colaborar com outros departamentos governamentais.

Perguntas frequentes

Que utilizações permite o acordo confidencial de IA entre a Google e o Pentágono?

Segundo o relatório do New York Times citando fontes com conhecimento do assunto, o acordo permite ao DoD usar a IA da Google para «qualquer finalidade governamental legal». Um porta-voz da Google afirma que a empresa defende que a IA não deve ser usada para vigilância interna em grande escala ou para armas autónomas sem supervisão humana.

Com que empresas de IA o Pentágono assinou acordos semelhantes?

De acordo com o relatório do New York Times, no mês passado o Pentágono assinou, respetivamente, acordos com a OpenAI e a xAI que permitem implementar IA em redes confidenciais; o acordo da Google é o caso mais recente de cooperação semelhante.

Qual é a posição da Anthropic sobre questões semelhantes?

De acordo com relatórios relacionados, em março deste ano o Pentágono classificou a Anthropic como uma empresa de «risco na cadeia de abastecimento», devido a a Anthropic se ter recusado a permitir ao governo federal o uso ilimitado dos seus modelos de IA; posteriormente, a Anthropic processou o Pentágono com base nessa determinação e procurou continuar a colaborar com outros departamentos governamentais.

Related News

Mídia norte-americana: um projecto de ordem executiva da Casa Branca permite a entrada do modelo Anthropic Mythos no governo

Citi ajusta a avaliação do mercado de IA para 4,2 biliões de dólares, com previsões de CapEx para 8,9 biliões

DeepMind × MOU da Coreia: Primeiro campus de IA no estrangeiro, Hassabis assina pessoalmente

A Google assinou um contrato de IA confidencial com o Pentágono, e centenas de funcionários subscreveram uma petição para se oporem — sem efeito.

Microsoft e OpenAI renovam acordo: cancelam a exclusividade, removem cláusulas de AGI